python - 使用TensorFlow創(chuàng)建邏輯回歸模型訓練結(jié)果為nan

問題描述

在TensorFlow中,我想創(chuàng)建一個邏輯回歸模型,代價函數(shù)如下:

使用的數(shù)據(jù)集截圖如下:

我的代碼如下:

train_X = train_data[:, :-1]train_y = train_data[:, -1:]feature_num = len(train_X[0])sample_num = len(train_X)print('Size of train_X: {}x{}'.format(sample_num, feature_num))print('Size of train_y: {}x{}'.format(len(train_y), len(train_y[0])))X = tf.placeholder(tf.float32)y = tf.placeholder(tf.float32)W = tf.Variable(tf.zeros([feature_num, 1]))b = tf.Variable([-.3])db = tf.matmul(X, tf.reshape(W, [-1, 1])) + bhyp = tf.sigmoid(db)cost0 = y * tf.log(hyp)cost1 = (1 - y) * tf.log(1 - hyp)cost = (cost0 + cost1) / -sample_numloss = tf.reduce_sum(cost)optimizer = tf.train.GradientDescentOptimizer(0.1)train = optimizer.minimize(loss)init = tf.global_variables_initializer()sess = tf.Session()sess.run(init)print(0, sess.run(W).flatten(), sess.run(b).flatten())sess.run(train, {X: train_X, y: train_y})print(1, sess.run(W).flatten(), sess.run(b).flatten())sess.run(train, {X: train_X, y: train_y})print(2, sess.run(W).flatten(), sess.run(b).flatten())

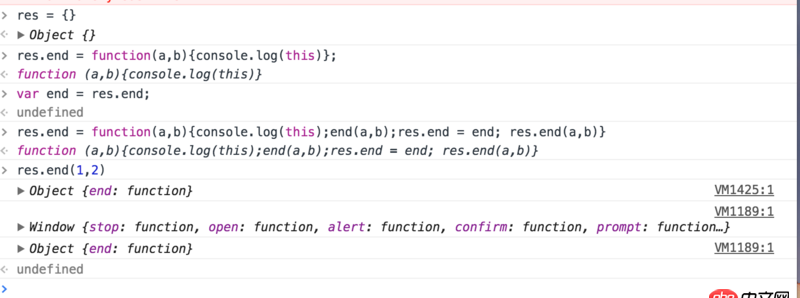

運行結(jié)果截圖如下:

可以看到,在迭代兩次之后,得到的W和b都變成了nan,請問是哪里的問題?

問題解答

回答1:經(jīng)過一番搜索,找到了問題所在。

在選取迭代方式的那一句:

optimizer = tf.train.GradientDescentOptimizer(0.1)

這里0.1的學習率過大,導致不知什么原因在損失函數(shù)中出現(xiàn)了log(0)的情況,結(jié)果導致了損失函數(shù)的值為nan,解決方法是減小學習率,比如降到1e-5或者1e-6就可以正常訓練了,我根據(jù)自己的情況把學習率調(diào)整為了1e-3,程序完美運行。

附上最終擬合結(jié)果:

相關文章:

1. html5 - ElementUI table中el-table-column怎么設置百分比顯示。2. python - 使用readlines()方法讀取文件內(nèi)容后,再用for循環(huán)遍歷文件與變量匹配時出現(xiàn)疑難?3. 對mysql某個字段監(jiān)控的功能4. css3 - less或者scss 顏色計算的知識應該怎么學?或者在哪里學?5. 注冊賬戶文字不能左右分離6. javascript - table列過多,有什么插件可以提供列排序和選擇顯示列的功能7. css - 網(wǎng)頁div區(qū)塊 像蘋果一樣可左右滑動 手機與電腦8. javascript - 數(shù)組的過濾和渲染9. html - vue項目中用到了elementUI問題10. JavaScript事件

網(wǎng)公網(wǎng)安備

網(wǎng)公網(wǎng)安備